北京时间:2026年4月9日

随着AI大模型技术的迅猛发展,宝宝AI助手等AI编程工具正从简单的“代码补全”工具进化为具备自主规划与执行的“全栈开发智能体”。2026年,以LLM(Large Language Model,大语言模型)为核心的生成式人工智能已正式从单纯的“对话式辅助工具”演进为具备自主规划、工具调用与协作能力的“数字劳动力”-。本文将从痛点入手,系统解析AI编程助手的核心技术原理,帮助你从“会用”走向“懂原理”。

一、痛点切入:为什么需要AI编程助手

传统开发方式的局限

先看一个传统场景:实现一个带分页的RESTful API。

传统方式:手动编写每一行代码 需要人工处理分页逻辑、数据库查询、异常处理、参数校验... def get_users_page(page=1, size=10): offset = (page - 1) size try: conn = get_db_connection() cursor = conn.cursor() cursor.execute("SELECT FROM users LIMIT %s OFFSET %s", (size, offset)) users = cursor.fetchall() 还要写total count查询... return users except Exception as e: 手动处理异常... pass

这段代码虽然功能完整,但暴露了传统开发的典型痛点:

耦合高:数据库操作与业务逻辑混杂,难以测试与复用

扩展性差:新增字段或修改逻辑需改动多处

维护困难:重复编写相似代码(增删改查)

代码冗余:分页逻辑在数十个接口中重复

AI编程助手的价值

2026年最新调研显示,72%的开发者已实现每日使用AI编码工具,AI生成或辅助代码占比已达42%,较2023年的6%大幅跃升-。AI编程助手的出现,正是为了解决上述痛点——将开发者从重复劳动中解放出来,专注于业务创新。

二、核心概念讲解:AI编程助手的“大脑”

LLM(大语言模型)——智能中枢

定义:LLM(Large Language Model,大语言模型)是一种基于深度学习的自然语言处理模型,通过海量代码和文本语料的预训练,具备理解自然语言指令并生成代码的能力。

拆解关键词:

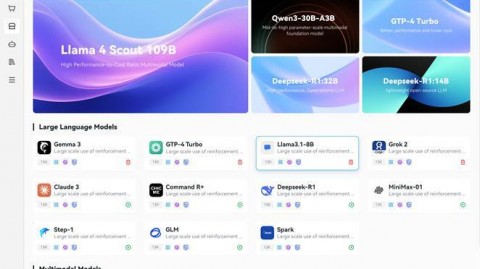

“大” :参数量级达数十亿甚至数万亿,如GPT-5、Claude系列等

“语言模型” :本质是对语言的概率建模,预测下一个词/Token

生活化类比:

把LLM想象成一个“超级学霸”——它读过全球所有编程书籍、GitHub仓库和技术文档,你只要用自然语言描述需求,它就能推理出最合适的代码实现。这个学霸在“上岗”前经过了海量数据的预训练,拥有强大的语言理解与逻辑推理能力-。

核心价值:LLM是AI编程助手的“大脑”,负责理解开发者的意图、进行逻辑推理、规划任务执行步骤。

三、关联概念讲解:RAG(检索增强生成)

RAG的定义

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种让LLM在生成答案前先“检索”相关信息的增强生成技术。

RAG与LLM的关系

两者是 “大脑”与“外部知识库” 的关系:

LLM:基于预训练知识的推理引擎

RAG:为LLM补充实时、上下文相关的外部知识

工作流程示例:

用户提问:“我们这个项目中users表的字段结构是什么?” → RAG:检索项目代码仓库,找到users表的schema定义 → LLM:基于检索结果+自身推理能力,生成准确回答

RAG的本质价值:解决LLM的“知识截止”问题(模型只记得训练时见过的东西),使其能够理解当前项目的具体上下文。通过RAG技术,AI代理可以获得外部记忆,获取最准确的编程范式-。

四、概念关系与区别总结

| 概念 | 本质 | 作用 | 类比 |

|---|---|---|---|

| LLM(大语言模型) | 预训练的推理引擎 | 理解意图、逻辑推理、代码生成 | 人类的大脑 |

| RAG(检索增强生成) | 实时检索+知识补充 | 为LLM提供当前项目的上下文信息 | 大脑的“引擎” |

| Agent(智能体) | 具备自主能力的执行单元 | 任务拆解、工具调用、多轮执行 | 一个有手有脚的人 |

一句话概括:LLM是大脑,RAG是补充记忆,Agent是大脑+身体的完整人-。

2026年,AI编程助手已完成从单一“代码补全工具”向“全栈开发智能体(Coding Agent)”的范式转移,核心竞争维度已聚焦于多语言混合项目的上下文理解、长链路需求拆解以及工程化交付的准确性-。

五、代码示例:从传统到AI助手的演进

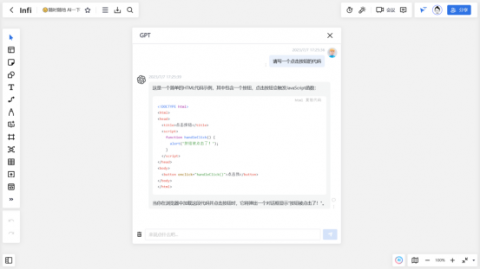

示例:使用AI编程助手生成Spring Boot接口

输入(自然语言指令) :

创建一个用户查询接口,支持分页和按用户名模糊AI助手生成代码:

// AI自动生成的Spring Boot代码 @RestController @RequestMapping("/api/users") public class UserController { @Autowired private UserService userService; @GetMapping("/page") public PageResult<UserDTO> getUsersPage( @RequestParam(defaultValue = "1") int page, @RequestParam(defaultValue = "10") int size, @RequestParam(required = false) String username ) { // AI自动处理了分页参数转换、模糊查询条件构建 Pageable pageable = PageRequest.of(page - 1, size); return userService.searchByUsername(username, pageable); } }

发生了什么:

AI助手理解自然语言中的分页参数(page、size)和条件(username模糊匹配)

自动映射到Spring Data JPA的Pageable对象

自动生成Service层和Repository层的配套代码

处理参数校验、异常处理等边界情况

对比传统方式,AI助手将约50行的手写代码压缩为几句自然语言描述,减少约70%以上的键盘输入-。

六、底层原理:支撑AI编程助手的关键技术

2026年,AI编程助手的底层技术架构可抽象为以下几大模块--:

1. 智能体架构:从单体模型到协同系统

AI编程助手的核心是把孤立的大模型升级为协同系统-。典型的Harness架构将智能体运行需求拆解为工具接入、编排协调、记忆管理、安全防护、网络通信、可观测性与推理执行七大核心模块-。

2. 上下文工程

AI助手的智能程度很大程度上取决于其获取到的上下文质量。当前主流方案通过代码图谱、Commit图谱、RepoWiki与Agentic Search等手段,构建立体化上下文感知体系-。在真实工程环境中,高质量的上下文构建往往比模型本身的大小更关键-。

3. 模型层

支撑上述能力的底层是代码大模型(Code LLM) 。2026年,主流AI编程模型已呈现“国际三强领跑,国产模型快速崛起”的格局-。

4. 执行框架(Harness)

当AI需要连续数小时地设计、写代码、搭应用时,光靠模型本身已不够,需要一套围绕模型运转的Harness(执行框架/调度框架) ,负责任务调度、工具调用和多智能体协同-。

七、高频面试题与参考答案

面试题1:请介绍一下LLM的核心原理,以及RAG和微调的区别

参考答案:

LLM核心原理:基于Transformer架构,通过海量数据的自监督预训练(Next Token Prediction),学习语言的统计规律和语义知识-。

RAG vs 微调:RAG不改变模型参数,通过实时检索补充知识;微调在特定数据上继续训练模型参数。RAG更适合知识频繁更新的场景,微调更适合固定风格的深度定制。

面试题2:AI编程助手的核心技术架构包含哪些关键模块?

参考答案:

LLM层:智能中枢,负责任务分解、路径规划和代码生成

上下文工程:通过RAG等技术获取项目代码、文档等上下文信息

工具调用层:与IDE、终端、数据库等外部工具交互

编排协调层:管理多个智能体或任务的执行顺序与依赖

面试题3:Agent和传统LLM有什么区别?

参考答案:

传统LLM:被动问答,单次输入输出,无自主行动能力

Agent(智能体) :具备感知-决策-执行闭环,能自主拆解任务、调用工具、多轮迭代-

关键差异:Agent能“做事”,LLM只能“说话”

面试题4:AI编程助手的RAG技术是如何提升代码生成质量的?

参考答案:

精准检索:基于向量相似度检索项目中的相关代码片段

上下文注入:将检索到的代码示例作为上下文输入LLM

规范对齐:结合项目现有的代码风格和依赖约束

提升效果:帮助实现从“能写代码”到“写对代码”的跨越-

八、总结

本文系统梳理了AI编程助手的核心技术体系,核心要点回顾:

✅ LLM是智能中枢:负责理解意图、推理生成

✅ RAG是外部记忆:让AI助手理解项目上下文

✅ Agent是执行单元:具备自主规划和工具调用能力

✅ 2026年AI编程已进入范式转移:开发者从“写代码的人”转变为“指挥AI写代码的人”-

重点提示与进阶预告

易错点:不要把RAG和微调混为一谈——两者解决的是不同维度的问题

关键趋势:2026年,多智能体协同开发已成为新范式,AI协作不再局限于人机配对,而演进为多智能体协同开发-

预告:下一篇将深入剖析多智能体协同开发架构,详解多Agent如何分工协作完成完整软件项目开发,敬请关注!

本文为“宝宝AI助手”技术科普系列第一篇,后续将带来更深入的架构设计与实战案例。