本文发布于北京时间2026年4月10日

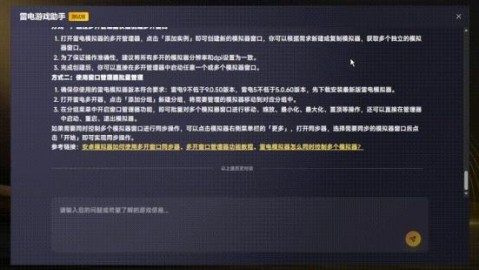

在2026年的今天,当你打开《和平精英》喊一句“注意右边草丛”,AI队友真的会转向掩体;当你在《逆水寒》中与NPC闲聊,它竟然记得你三天前说过的话。这些体验背后,都离不开一个核心技术的支撑——AI网游助手,或者说更正式的名字:基于大语言模型的游戏智能体(LLM-based Game Agent)。这个技术正从实验室走向千万级玩家,但它到底是怎么运作的?很多开发者只会调用API却不懂原理,面试时被问“Agent的记忆机制”就卡壳。本文将以AI网游助手为主线,从痛点切入到代码实现,帮你一次性理清这门技术的全貌。

本文系列预计覆盖:游戏Agent架构设计、RAG增强NPC对话、多智能体协作、强化学习与LLM融合等。本篇为系列开篇。

一、痛点切入:传统NPC为什么“不够用”

先看一个典型场景。在一款RPG游戏中,你想向NPC打听“百年前的大灾变”。用传统脚本NPC,代码大概是这样的:

传统脚本NPC的对话逻辑 def npc_response(question): if "大灾变" in question: return "我记得那天天色很黑,风很大" elif "宝藏" in question: return "我没听说过什么宝藏" else: return "不好意思,我听不懂你在说什么"

这种硬编码的方式存在几个致命缺陷:

耦合高:对话逻辑和游戏业务代码混在一起,每新增一个NPC就要写一套脚本。

扩展性差:面对玩家天马行空的问题,脚本只能机械匹配关键词。

缺乏记忆:NPC不记得你是谁、不记得之前的对话,每次互动都是“初次见面”。

维护成本极高:为一款开放世界的50个NPC编写行为树,可能需要团队花费数月,但玩家很快就会发现模式的重复-40。

这正是AI网游助手技术被需要的原因。2026年GDC大会上,《和平精英》分享了“大模型+AI Bot”架构,将AI伙伴从一个强化工具升级为真正的队友——听指挥、有记忆、可养成-3。AI技术的介入,让NPC从“提线木偶”变成了“有灵魂的游戏居民”-13。

二、核心概念:LLM与游戏Agent

2.1 LLM(Large Language Model,大语言模型)

LLM是指参数量通常在十亿级以上的大型神经网络模型,通过对海量文本数据的学习,掌握了人类语言的基本规律、事实知识和推理能力。常见的如GPT-4、Qwen、DeepSeek等。

生活化类比:LLM就像一个读过万卷书的博学家——它知道“城堡的守卫通常会在晚上换岗”,但它自己不会真的去站岗。

2.2 游戏Agent(智能体)

游戏Agent是一个能感知游戏环境、做出决策并执行动作的自主实体。根据网易伏羲的定义,智能NPC是具备感知、认知、决策与记忆能力的Agent,通过与游戏环境不断交互来影响游戏世界-13。

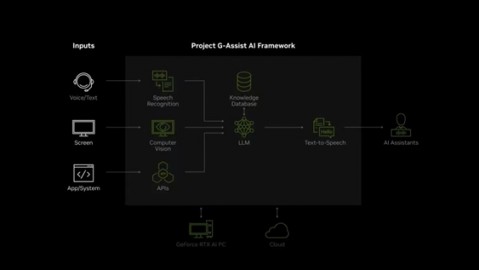

核心组成:感知模块(理解游戏画面/玩家输入)→ 记忆模块(存储历史交互)→ 推理模块(规划行动)→ 执行模块(输出操作/对话)。

生活化类比:LLM是大脑,Agent是整个“人”——除了大脑还需要眼睛(感知)、记忆(存档)、手和脚(执行)。

2.3 两者的关系

一句话概括:LLM是Agent的“认知引擎”,Agent是LLM在游戏世界的“肉身” 。

LLM解决的是“思考”问题——理解意图、生成回应;Agent解决的是“行动”问题——感知状态、执行操作。两者结合,才能让虚拟角色既“会说话”又“会做事”。

三、核心架构:游戏Agent的技术全景

一个完整的AI网游助手,其技术架构包含三大模块-73:

3.1 感知-动作接口

Agent需要“看懂”游戏世界。以2026年1月超参数科技推出的游戏智能体COTA为例,它采用Qwen3-VL-8B-Thinking多模态大模型,能同时处理视觉信息和文本指令,在FPS游戏中实现实时高频决策,表现媲美顶尖人类选手-1。

3.2 记忆模块

这是区分“智能NPC”和“脚本木偶”的关键分水岭。2026年游戏AI的突破性进展之一,就是NPC的长期记忆(Long-Term Memory, LTM) -。《和平精英》的AI伙伴经历了三个进化阶段:第一阶段是专业与拟人,第二阶段引入记忆与陪伴,第三阶段实现专属养成-3。

记忆系统通常分为:

短期记忆:当前会话内的对话历史

长期记忆:跨会话存储的玩家偏好、历史事件

情境记忆:特定场景下的知识片段

3.3 推理与决策模块

Agent如何“想”然后“做”?目前有两种主流思路:

| 对比维度 | 传统行为树/FSM | LLM驱动Agent |

|---|---|---|

| 行为来源 | 设计师预先编写 | 基于上下文实时生成 |

| 记忆 | 简单状态标记 | 自然语言记忆流 |

| 规划能力 | 预设日程/脚本 | 动态生成计划 |

| 适应性 | 只能处理预设场景 | 能应对未见过的新情况 |

来源:基于生成式智能体技术对比-40

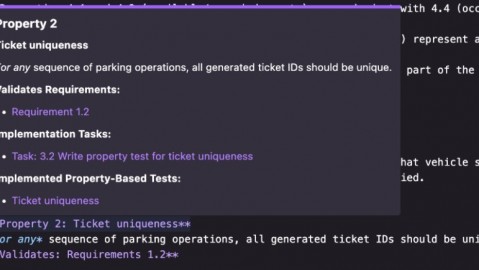

在星际争霸II等实时策略游戏中,新提出的MASMP(Memory-Augmented State Machine Prompting) 框架将状态机提示与记忆机制相结合,实现了60%的胜率(对战最高难度内置AI),远超基线方法(0%)-69。

四、代码实现:用LangChain搭建一个AI网游助手

理论讲完了,来看实际代码。下面我们用LangChain框架,搭建一个最简单的RAG(检索增强生成)增强型NPC对话系统。

4.1 核心思想

让AI“查资料后再回答”,而不是凭空编造。这个机制叫做 RAG(Retrieval-Augmented Generation,检索增强生成) 。它的流程是:文档解析 → 向量化 → 存储 → 检索 → 大模型生成-20。

4.2 极简实现

基于LangChain-Chatchat的NPC对话系统核心代码 from langchain.document_loaders import TextLoader from langchain.text_splitter import CharacterTextSplitter from langchain.embeddings import OpenAIEmbeddings from langchain.vectorstores import FAISS from langchain.chains import RetrievalQA from langchain.llms import ChatOpenAI Step 1: 加载游戏设定文档(比如NPC的背景故事、世界观设定) loader = TextLoader("./game_lore/elf_village.txt") documents = loader.load() Step 2: 文档切块,保证检索精度 text_splitter = CharacterTextSplitter(chunk_size=500, chunk_overlap=50) docs = text_splitter.split_documents(documents) Step 3: 向量化存储(将文本转换为高维向量存入FAISS数据库) embeddings = OpenAIEmbeddings() vectorstore = FAISS.from_documents(docs, embeddings) Step 4: 构建检索增强问答链 qa_chain = RetrievalQA.from_chain_type( llm=ChatOpenAI(model="gpt-3.5-turbo", temperature=0.7), chain_type="stuff", retriever=vectorstore.as_retriever(search_kwargs={"k": 3}) ) Step 5: 玩家提问时,AI先从知识库检索相关文档,再生成回答 player_question = "听说精灵族有一种古老的魔法,能有什么用?" 系统会先去知识库检索“精灵魔法”相关段落,再把检索结果+问题一起送给LLM answer = qa_chain.run(player_question) print(f"NPC回答:{answer}")

执行流程解析:

玩家提问:“精灵魔法有什么用?”

检索:系统将问题向量化,在知识库中找出最相似的3个文档片段(比如“精灵魔法的起源”“魔法实战效果”等)

增强:将检索到的文档片段+原始问题一起打包

生成:LLM基于检索到的文档(而非自己的“幻觉”)生成回答

输出:NPC说出符合游戏世界观的精准回应

这种RAG架构的核心优势是解决了LLM的“幻觉”问题——让模型“查资料后再回答”,就像考场上的开卷考试-20。对于开发者而言,这套机制让AI网游助手的搭建变得标准化且易于扩展。

4.3 进阶:让Agent“动”起来

如果想让Agent不只是“说话”,还能“做事”(比如打开箱子、攻击敌人),就需要引入工具调用(Tool Calling) 机制。LangChain4j提供了Java实现方案:将游戏规则(如攻击判定、物品使用)实现为Java方法,通过LangChain4j暴露为AI可调用的“工具”,在游戏过程中动态执行-21。

五、底层原理:大模型如何驱动游戏智能

要理解AI网游助手的底层,需要把握两个关键技术点:

5.1 后训练(Post-Training)

通用大模型(如GPT-4)懂得很多知识,但并不懂你的游戏。网易伏羲的做法是在基座大模型上做后训练:结合不同游戏的专属设定进行调整,确保NPC行为与游戏场景高度契合-13。具体技术手段包括:

SFT(Supervised Fine-Tuning,监督微调) :用游戏专属对话数据微调模型

RLHF(Reinforcement Learning from Human Feedback,基于人类反馈的强化学习) :通过人类偏好反馈优化模型行为-16

5.2 多模态融合

现代AI网游助手不只理解文字,还能“看”和“听”。以Ubisoft的《Teammates》为例,NPC通过大型语言模型 + 语音识别 + 即时决策能力,成为能听懂玩家语音指令的活队友-12。其底层结合了Google Gemini模型与自家中介软件(middleware),实现了从语音输入到战术执行的全链路处理-12。

六、高频面试题与参考答案

以下是围绕“游戏AI Agent / LLM驱动NPC”方向的高频面试题:

Q1:请简述LLM驱动游戏Agent的核心架构。

参考答案(踩分点:感知-记忆-决策-执行四层):

一个完整的LLM游戏Agent包含四层:感知层(通过多模态模型理解游戏画面和玩家输入)、记忆层(短期记忆存会话历史,长期记忆存跨会话信息,通过向量数据库检索)、决策层(LLM作为认知引擎进行推理规划,可结合行为树或状态机增加确定性)、执行层(将决策转化为游戏内动作,通过函数调用或脚本执行)。四层协同工作,实现“像人一样”的实时交互。

Q2:在游戏场景中,为什么需要RAG?与传统微调相比有什么优势?

参考答案(踩分点:幻觉抑制、实时更新、成本控制):

游戏世界观庞大且持续更新,传统微调方式每次更新都要重新训练,成本高、周期长。RAG通过检索外部知识库让LLM“查资料后再回答”,解决了两大问题:一是抑制LLM幻觉,确保NPC回答符合游戏设定;二是知识可实时更新——只需更新文档库,无需重新训练模型。但它也有劣势:每次回答都需检索,延迟略高;且检索质量直接影响回答准确性。

Q3:如何解决LLM驱动的游戏Agent响应延迟问题?

参考答案(踩分点:本地部署、模型蒸馏、推理优化):

主要策略有三:一是本地部署小模型,如NVIDIA ACE支持的Qwen3-8B可在PC端本地运行,配合IGI SDK优化推理与图形处理的并行执行-17-66;二是模型蒸馏,将大模型能力迁移到小模型以减少推理开销;三是分层决策,高频操作(如移动、攻击)走传统行为树,低频决策(如策略规划)走LLM,COTA的“双系统分层架构”就是典型范例-1。

Q4:请解释游戏Agent中的记忆机制,以及如何实现长期记忆。

参考答案(踩分点:短期/长期/情境记忆、向量存储):

游戏Agent记忆通常分为三层:短期记忆存储当前会话的对话历史,直接放入LLM上下文;长期记忆通过向量数据库存储过往交互的关键信息,通过检索相关片段注入提示词;情境记忆存储特定任务或场景的知识。实现上,可采用Memory-Augmented State Machine Prompting(MASMP) 等框架,将结构化状态机与记忆机制统一,兼顾行动可靠性与战术一致性-69。

Q5:游戏AI面试中常见的考察方向还有哪些?

参考答案(踩分点:端到端能力、Prompt设计、调试策略):

除了上述技术点,面试官常考察的还包括:提示设计(如何将游戏状态序列化为提示词)、动作空间约束(如何限制模型输出到合法动作)、重试与降级策略(处理模型输出无效或超时的情况)、实验追踪与调试(如何记录Agent决策链以便排查失败案例)-34。对SFT和RL训练方法的理解、数据合成技巧、自动评测指标设计也是腾讯等大厂的高频考点-30。

七、结尾总结

回顾本文核心要点:

| 主题 | 核心结论 |

|---|---|

| 痛点 | 传统脚本NPC耦合高、扩展性差、无记忆,已无法满足玩家需求 |

| 核心概念 | LLM是认知引擎,Agent是行动实体;两者结合才构成完整AI网游助手 |

| 架构全景 | 感知-动作 + 记忆 + 推理决策,三模块协同工作 |

| 代码实现 | RAG + LangChain是最快速的落地方式,用“检索+生成”解决幻觉问题 |

| 底层原理 | 后训练(SFT/RLHF)让模型懂游戏;多模态融合让AI能“看”能“听” |

| 面试考点 | 四层架构、RAG vs 微调、延迟优化、记忆机制——高频必考 |

需要重点强调的易错点是:不要把“大模型调用”等同于“游戏Agent” 。大模型解决的是“想什么”,Agent解决的是“怎么感知、怎么记住、怎么行动”——缺少任何一个模块,AI网游助手都无法真正落地。当游戏世界从“脚本驱动”走向“智能涌现”,理解这门技术的人,将在下一波游戏产业变革中占据先机。

下一篇文章将深入记忆机制的工程实现,包括向量数据库选型、记忆压缩策略、以及如何避免Agent“遗忘”关键信息,敬请期待。

关键词:AI网游助手 | LLM Agent | RAG | 游戏NPC | LangChain | 面试考点

适合人群:技术入门/进阶学习者、在校学生、面试备考者、游戏/AI开发工程师